概要

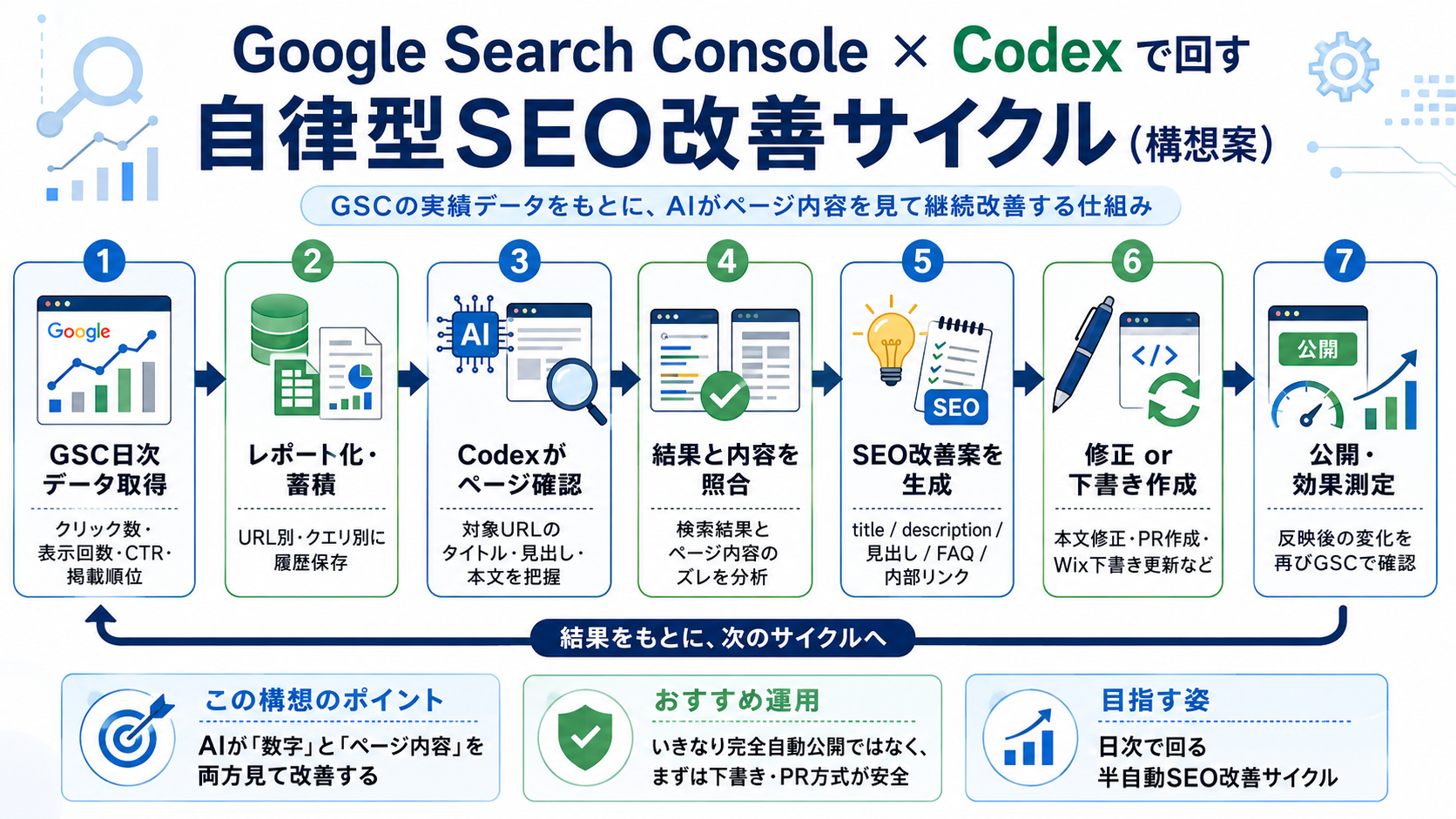

今回は、Google Search Consoleの実績データと、Codexによるページ内容の確認・修正支援を組み合わせて、SEO改善を半自動で回していく仕組みを構想してみました。

現時点では、まだ実装済みのシステムではなくアイデア段階です。 ただし、「検索データを見る」「ページ内容を確認する」「改善案を出す」「修正する」「効果を再確認する」という流れは、テックブログ運用や公式ホームページ改善と相性がよさそうです。

自律型SEO改善サイクルの全体像

まずは、今回考えている全体像を図にするとこのようなイメージです。

Search Consoleの実績データを起点に、AIが対象ページの内容を確認し、改善案の作成や修正案の生成までつなげていく構想です。 最終的には、改善結果を再びSearch Consoleで確認し、次の改善サイクルへ回します。

なぜこの仕組みを考えたのか

Search Consoleは非常に便利ですが、数字を見ただけでは改善作業が止まりやすいです。

URLごとに、クリック数、表示回数、CTR、平均掲載順位は確認できます。 しかし、そこから「結局どのページをどう直すべきか」まで考えるには、ページ本文、見出し、title、description、内部リンクを人間が見に行く必要があります。

そこで、AIに次の2つを同時に見せれば、改善案づくりまでつなげやすいのではないかと考えました。

- Search Consoleの実績データ

- 実際のページ内容

数字だけではなく、ページ内容まで確認することで、「表示回数はあるのにクリックされない」「検索クエリと本文の焦点が少しずれている」「関連する記事や用語集への導線が足りない」といった改善候補を拾いやすくなります。

想定している処理フロー

構想している流れは、次の7ステップです。

-

GSCの日次データを取得する URL別、クエリ別に、クリック数、表示回数、CTR、平均掲載順位などを取得します。

-

レポートとして整形・蓄積する 日次や週次で見やすい形に加工し、改善傾向や悪化傾向を追いやすくします。

-

Codexが対象ページを確認する 対象URLのtitle、description、見出し構成、本文、関連記事、内部リンクを確認します。

-

数字とページ内容を照合する 表示回数は多いのにCTRが低い、掲載順位が落ちている、検索クエリと本文の見出しが合っていない、といった問題を洗い出します。

-

SEO改善案を生成する title案、description案、見出し改善案、FAQ追加案、内部リンク追加案、関連記事候補などを出します。

-

修正案または下書きを作る いきなり本番反映せず、まずは記事修正案、CMS下書き、またはPull Requestの形にします。

-

公開後に効果を再確認する 修正後の変化を再びSearch Consoleで確認し、次の改善サイクルへ回します。

この構想のポイント

この仕組みで狙っているのは、単純なアクセス解析ではなく、改善作業までつながるループを作ることです。

- 数字だけでなく、ページ内容までAIが見る

- 改善候補ページの優先順位を付けやすくする

- 人手で見落としやすい内部リンク不足を拾う

- titleやdescriptionの改善案を継続的に出す

- 記事改善を単発作業ではなくサイクル化する

特にテックブログでは、記事数が増えるほど、過去記事の改善が後回しになりやすくなります。 日次や週次で改善候補を出せれば、新規記事の作成と既存記事の改善を両方回しやすくなります。

いきなり完全自動公開にしない方がよい理由

この構想は便利そうですが、最初からAIが勝手に本番記事を修正して公開するところまで進めるのは危険です。

例えば、次のようなリスクがあります。

- 文脈に合わない追記をしてしまう

- 読者に必要ないキーワードを詰め込みすぎる

- サイト全体のトーンとずれる

- 説明の正確性よりも検索語だけを優先してしまう

- 公式HP側の営業導線とテックブログ側の技術説明が噛み合わなくなる

そのため、現実的には段階的に進めるべきだと考えています。

- まずは改善レポートを出す

- 次に記事修正の下書きを作る

- その次にPull RequestやCMS下書きとして確認可能にする

- 最終公開は人間が確認してから行う

SEOは検索エンジンだけを見るものではなく、読者が目的の情報へたどり着きやすくするための改善です。 そのため、自動化しても、人間の確認ポイントは残す方が安全です。

まず作るならこの形が現実的

最初のMVPとしては、次の形が現実的です。

- Search Consoleから日次データを取得する

- URL別に改善候補ページを抽出する

- 対象ページのtitle、description、見出し、本文を取得する

- CodexまたはAIに分析させる

- 改善レポートをMarkdownやHTMLで出力する

この段階なら、いきなり本番ページを書き換えずに、「改善案を安定して出せるか」を検証できます。 レポートの精度が上がってから、下書き作成やPull Request作成へ進める方が安全です。

将来的に目指す姿

将来的には、次のような半自動のSEO改善サイクルへ育てられると面白いと考えています。

- 日次でGSCデータを取得

- 改善候補ページを抽出

- ページ本文と検索クエリを照合

- 改善案を生成

- 下書きまたはPull Requestを作成

- 人間が確認して公開

- 効果測定して次の改善へ回す

テックブログ側では、記事、用語集、開発事例、公式ホームページへの導線を見直せます。 公式ホームページ側では、検索流入のある技術テーマから、相談ページや対応事例へつなげる改善に使えます。

まとめ

今回は、Google Search ConsoleとCodexを組み合わせて、SEO改善を継続的に回していく仕組みの構想案をまとめました。

現時点ではまだアイデア段階ですが、実績データとページ内容をAIが両方見ることで、従来よりも実務的な改善ループを作れる可能性があります。

まずは完全自動公開ではなく、分析、改善案生成、下書き作成のあたりから検証していくのがよさそうです。